识别|避免自动驾驶事故,CV领域如何检测物理攻击?(19)

如果对手能够操纵模型对惰性模式做出反应 , 那么他们就可以绕过防御后在良性输入和对手输入之间生成类似的输出 。 作者通过使用标准随机噪声模式和一个新的棋盘格模式(如图 14 所示) , 证明了我们可以保证模式 s 的隐私性 。 由表 9 , 我们可以看到随机噪声模式和棋盘格模式的 TP 和 TN 率在 ≤0.25% 范围内 。 此外 , 防御方始终能够通过使用梯度下降找到惰性模式 , 以最小化所有类别的响应置信度 。 只要模式 s 是保密的 , SentiNet 的这个组件就是安全的 。

文章图片

图 14. 惰性模式:本文使用的惰性模式为左侧显示的随机噪声;可能使用的另一种模式是右侧的棋盘格模式

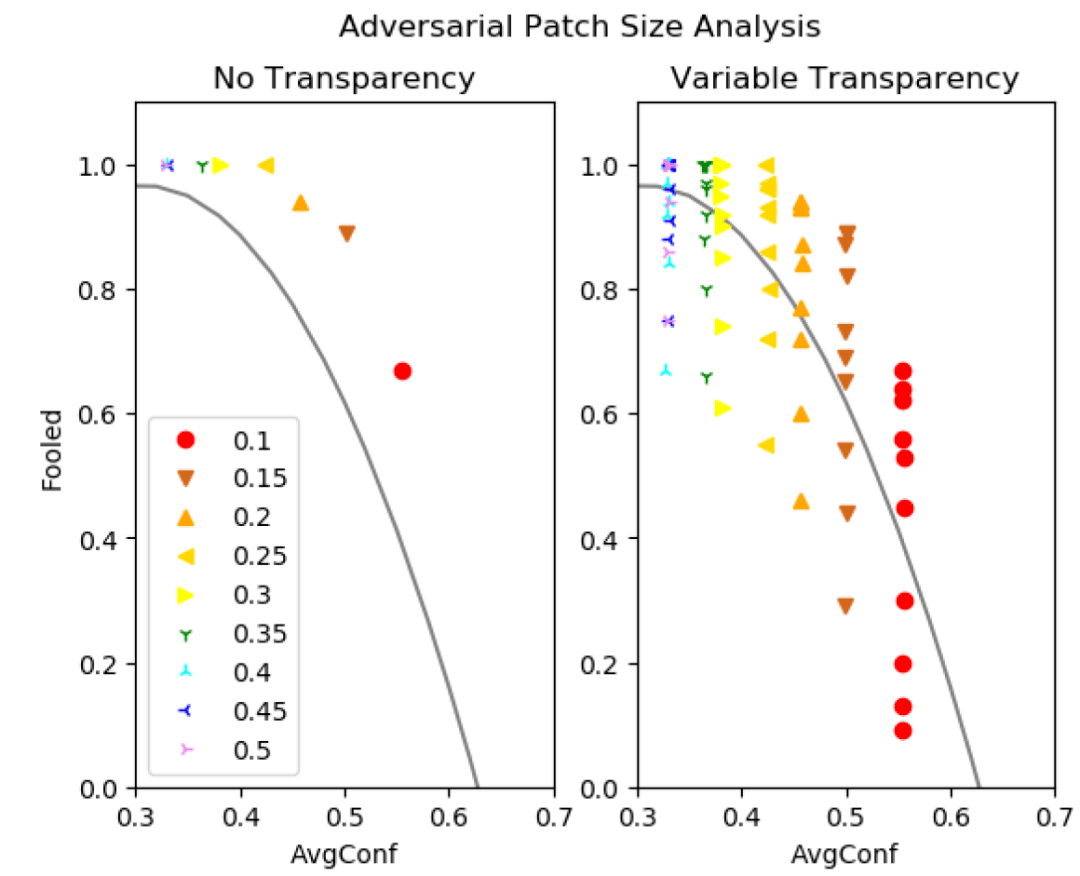

如果攻击者使用足够大的补丁 , X 上的平均置信度将降低 , 从而降低防御的有效性 。 由图 15 可以看出 , 对于对抗性补丁 , 攻击的 avgConf 随着补丁大小的增加而下降 。 通过增加补丁的透明度 , 我们可以将攻击降低到阈值以下 , 同时保持非常高的攻击成功率 。

文章图片

图 15. 对抗性补丁大小分析

4、小结

我们在这篇文章中讨论了多媒体领域的物理攻击问题 , 包括图像领域、音频领域等 。 与算法攻击相比 , 在图像或音频上施加物理攻击的难度性低 , 进一步损害了深度学习技术的实用性和可靠性 。 我们选择了三篇文章从攻击和防御的角度分别进行了探讨 , 同时包括了图像领域和音频领域的攻击 。 由于物理攻击对于人类来说是易于发现的 , 所以从文章给出的实验结果来看 , 不同方法的防御效果都不错 。 不过 , 几篇文章中谈到的防御都是限定攻击类型的防御 , 如何对不可知的攻击进行有效防御仍值得进一步研究和探讨 。

分析师介绍:Jiying , 工学博士 , 毕业于北京交通大学 , 曾分别于香港中文大学和香港科技大学担任助理研究员和研究助理 , 现从事电子政务领域信息化新技术研究工作 。 主要研究方向为模式识别、计算机视觉 , 爱好科研 , 希望能保持学习、不断进步 。

本文参考引用的文献

[1] Kevin Eykholt; Ivan Evtimov; Earlence Fernandes; Bo Li; Amir Rahmati; Chaowei Xiao; Atul Prakash; Tadayoshi Kohno; Dawn Son , Robust Physical-World Attacks on Deep Learning Visual Classification , CVPR 2018 ,https://ieeexplore.ieee.org/document/8578273(https://robohub.org/physical-adversarial-examples-against-deep-neural-networks/)

[2] Zirui Xu , Fuxun Yu; Xiang Chen , LanCe: A Comprehensive and Lightweight CNN Defense Methodology against Physical Adversarial Attacks on Embedded Multimedia Applications , 25th Asia and South Pacific Design Automation Conference (ASP-DAC) , 2020 , https://ieeexplore.ieee.org/document/9045584

推荐阅读

- 识别|外卖界又一黑科技 饿了么计划2022年覆盖100000顶智能头盔

- 语言识别|AI技术,让我们“听”懂聋人

- AI财经社|美团公布共享单车指纹解锁专利,网友调侃称期待人脸识别解锁

- Huawei|传大众与华为成立合资自动驾驶技术公司 回应称现阶段没有可以确认的消息

- 视点·观察|如何避免社交电商以“经销之名”行“传销之实”

- 模式|华为拍摄月亮专利获授权:可自动识别月亮并对焦

- 广西|秒级核验通行,广西机场推广刷身份证自动核验健康码

- 澎湃新闻|如何避免社交电商以“经销之名”行“传销之实”

- IT|达拉斯希望成为福特下一个自动驾驶汽车工厂的所在地

- 界面新闻|华为月亮拍摄专利获授权,可自动识别月亮并对焦