此外 , 团队首次建立了一个大规模手工标注数据集 , 首先在CelebAMask-HQ数据集中筛选了15010张图片 , 每个图片分别由十个工作人员手工标注十个文本描述 , 十个描述按照由粗到细的顺序分别描述人脸的不同部位 。

实验结果

团队对提出的方法进行了定性和定量分析[5,6] , 实验结果表明 , 该方法不仅能生成高质量的图像 , 并且更加符合文本描述 。

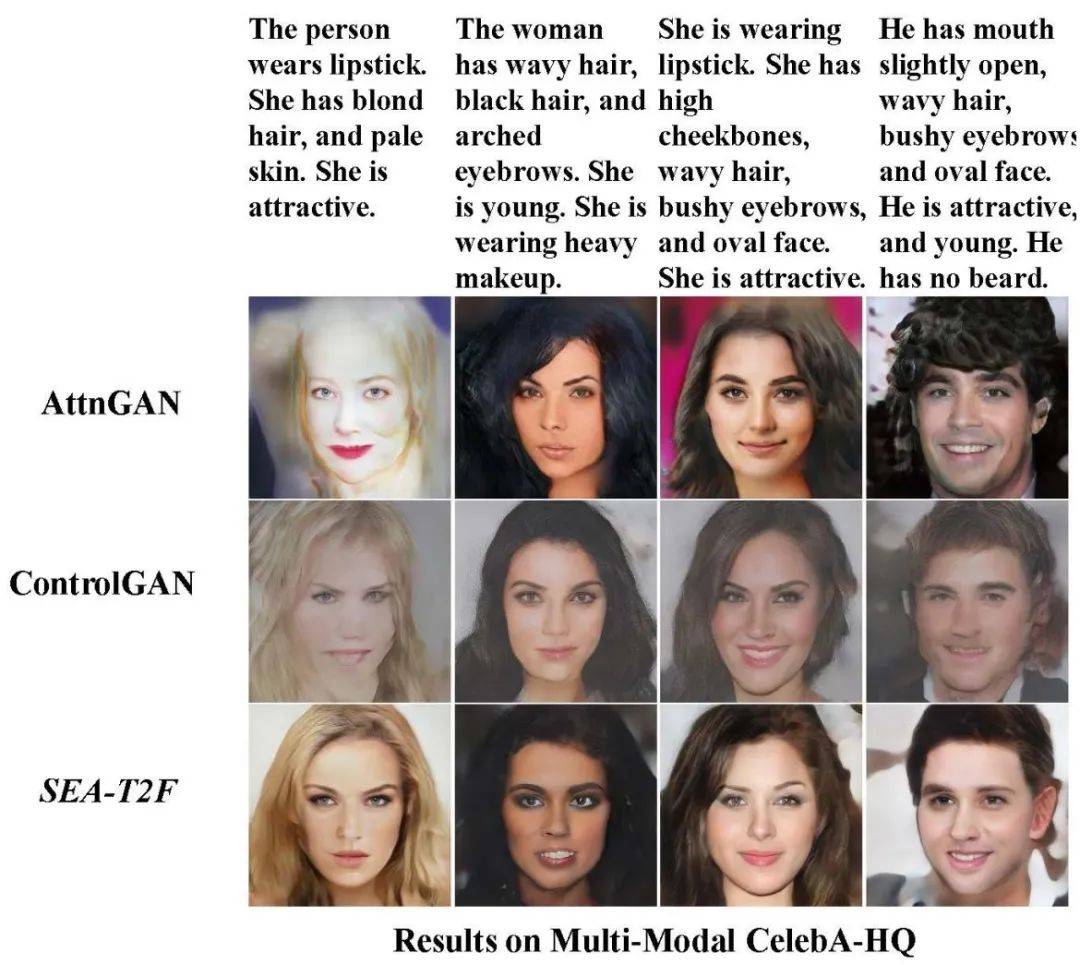

文章图片

图3 不同方法比较结果

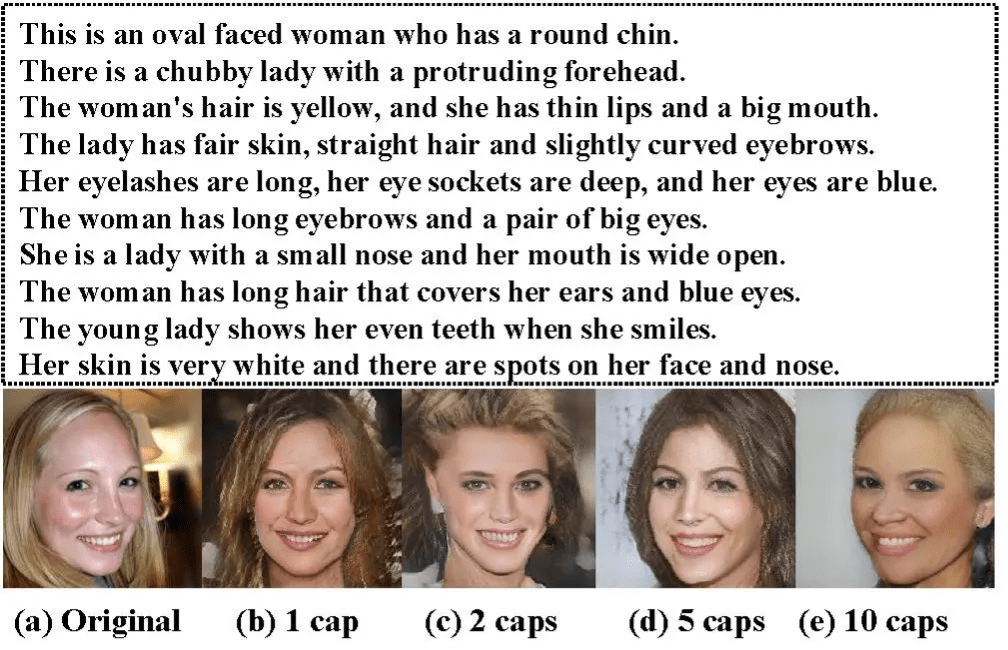

文章图片

图4 不同数量输入的生成结果

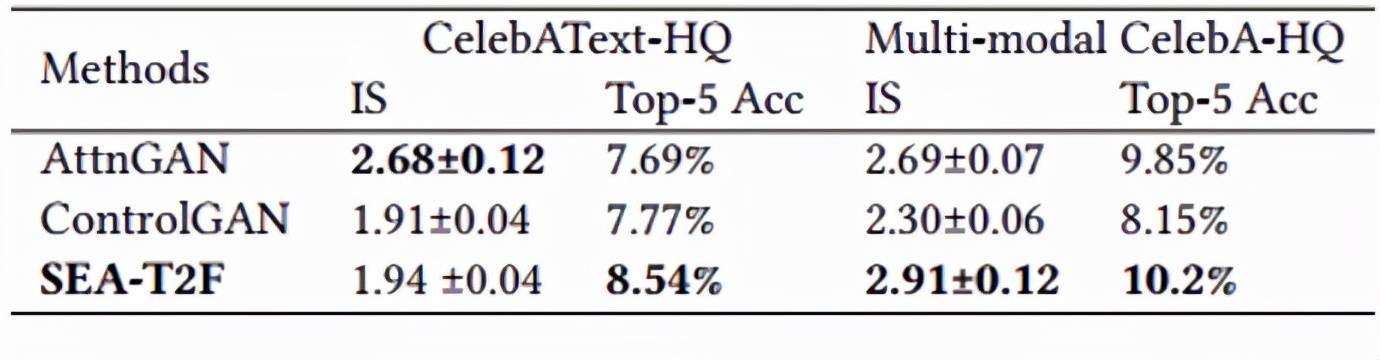

文章图片

【人脸|中科院自动化所联合北方电子设备研究所提多输入文本人脸合成方法】表1 不同方法的定量比较结果

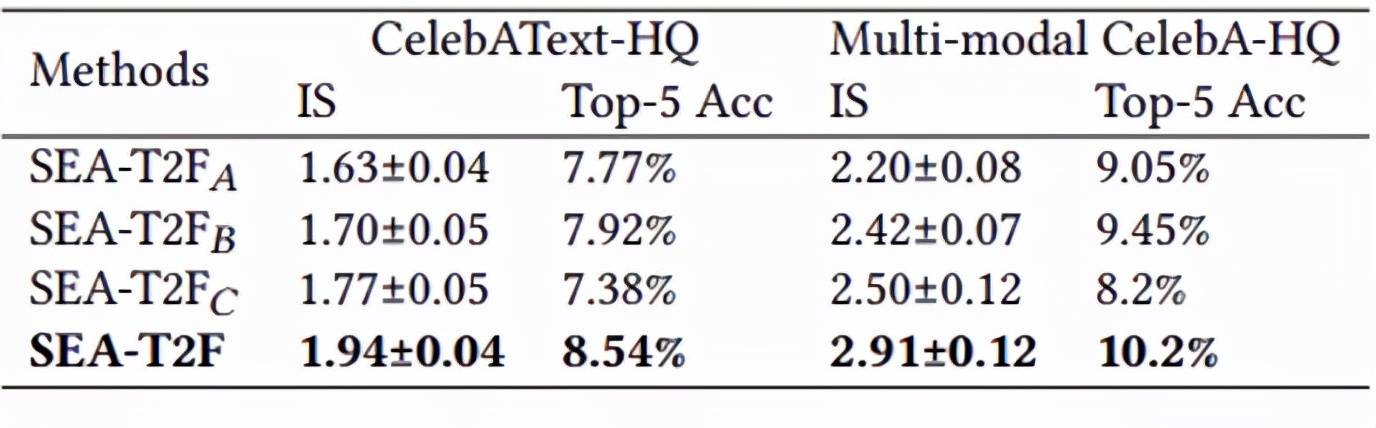

文章图片

表2 消融实验结果:前三行分别表示网络去除SFIM , AMC , 和属性分类损失 。

参考文献:

1. Osaid Rehman Nasir, Shailesh Kumar Jha, Manraj Singh Grover, Yi Yu, Ajit Kumar, and Rajiv Ratn Shah. 2019. Text2FaceGAN: face generation from fine grained textual descriptions. In IEEE International Conference on Multimedia Big Data (BigMM). 58–67.

2. Xiang Chen, Lingbo Qing, Xiaohai He, Xiaodong Luo, and Yining Xu. 2019. FTGAN: A fully-trained generative adversarial networks for text to face generation. arXiv preprint arXiv:1904.05729 (2019).

3. David Stap, Maurits Bleeker, Sarah Ibrahimi, and Maartje ter Hoeve. 2020. Conditional image generation and manipulation for user-specified content. arXiv preprint arXiv:2005.04909 (2020).

4. Weihao Xia, Yujiu Yang, Jing-Hao Xue, and Baoyuan Wu. 2021. TediGAN: Textguided diverse image generation and manipulation. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR). 2256–2265.

5. Tao Xu, Pengchuan Zhang, Qiuyuan Huang, Han Zhang, Zhe Gan, Xiaolei Huang, and Xiaodong He. 2018. Attngan: Fine-grained text to image generation with attentional generative adversarial networks. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR). 1316–1324.

6. Bowen Li, Xiaojuan Qi, Thomas Lukasiewicz, and Philip Torr. 2019. Controllable text-to-image generation. In Advances in Neural Information Processing Systems (NeuIPS). 2065–2075.

推荐阅读

- 人脸|“骁龙870版”小米12:小米12X发布:3199元起

- 人脸信息|如何护住我们的“脸”

- 犯罪学|人脸识别有易破解隐患 准确定罪存在一定争议

- 人脸|部分商家热衷“盗采”消费者人脸信息,怎么破?

- 材料|中科院成功研制出 4D 打印血管支架

- 青少年|中科院老科学家科普演讲走进三亚中小学校

- 重整|中科院 3D 打印制备车载甲醇重整制氢催化剂研究取得新进展

- 风险|中科院院士王建宇:商业航天很火但风险也比较大

- 轻喜剧|中科院物理所推出科普轻喜剧《闹起来,费先生》

- 技术|中科院成都分院启动入驻成都科学城