机器之心专栏

字节跳动-智能创作团队

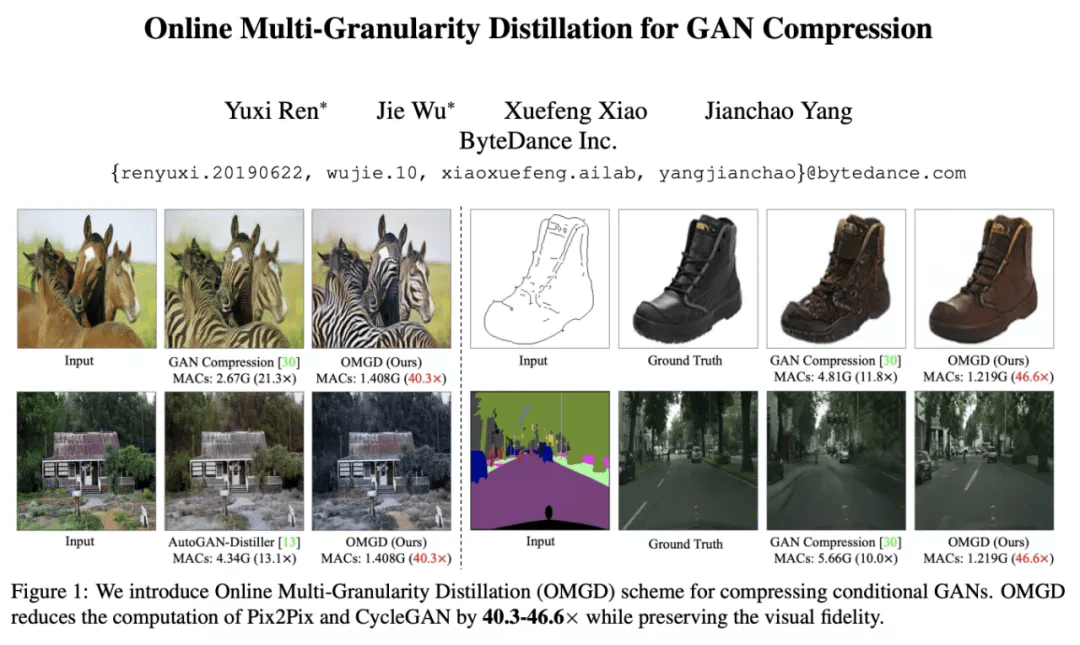

字节跳动 - 智能创作团队提出了一种用于学习轻量级 GAN 的在线多粒度蒸馏算法 OMGD 。 该算法能够把 GAN 模型的计算量减少到最低 1/46、参数量减少到最低 1/82 的程度 , 并保持原来的图像生成质量 。近年来 , 生成对抗网络(GAN)在图像生成、图像翻译等多种视觉应用中取得了显著成果 。 尽管 GAN 模型给图像生成带来了不同程度的提升 , 但大部分模型的部署都涉及巨大的计算资源和内存消耗 。 这成为在资源受限的移动设备或其他轻量级物联网设备上部署 GAN 的一个关键瓶颈 。

GAN 压缩方向已经成为业界的挑战之一 , 不少高校和科技公司对此投入研究力量 。 但当前的 GAN 压缩算法主要存在两个方面的问题:一方面 , 当前研究倾向于直接采用成熟的模型压缩技术来进行压缩 , 而这些技术不是面向 GAN 定制的 , 缺乏对 GAN 复杂特性和结构的探索;另一方面 , GAN 压缩通常被规划为一个多阶段的任务 , 多阶段设置中对时间和计算资源的要求较高 。

为了解决上述问题 , 字节跳动 - 智能创作团队提出了一种面向 GAN 压缩的在线多粒度蒸馏算法(Online Multi-Granularity Distillation , 简称 OMGD) 。 该算法能够把 GAN 模型的计算量减少到最低 1/46、参数量减少到最低 1/82 的程度 , 并保持原来的图像生成质量 。 这为在资源受限的设备上部署实时图像翻译的 GAN 模型提供了一个可行的解决方案 。

OMGD 研究论文已入选 ICCV2021 , 相关代码也已开源 。

文章图片

论文链接:https://arxiv.org/abs/2108.06908

GitHub 链接:https://github.com/bytedance/OMGD

引言

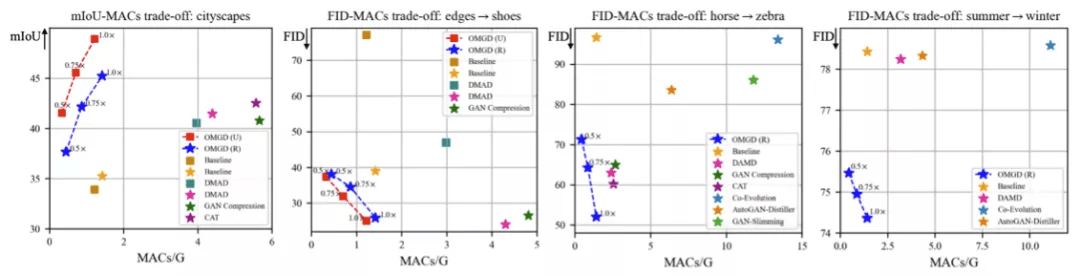

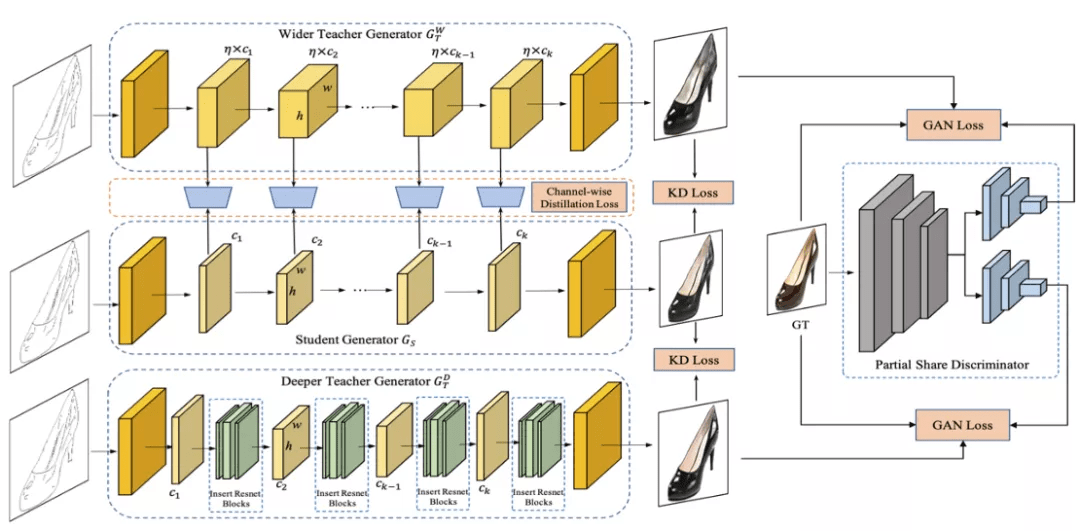

论文提出了一种新的在线多粒度蒸馏(OMGD)方案来获得轻量级的 GAN , 以较低的计算成本生成高保真图像 。 OMGD 放弃了复杂的多级压缩过程 , 设计了一种面向 GAN 的在线蒸馏策略 , 可以一步获得压缩模型 。 OMGD 还从多个层次和粒度挖掘潜在的图像信息 , 以帮助优化压缩模型 。 这些概念可以看作是辅助监督线索 , 这对于突破低计算成本模型的容量瓶颈至关重要 。

文章图片

方法

文章图片

1. 在线蒸馏

论文提出了一种面向 GAN 的在线蒸馏算法来解决离线蒸馏中的三个关键问题:

第一 , 传统离线蒸馏方法中的学生生成器应保持一定的容量 , 以保持与鉴别器的动态平衡 , 避免模型崩溃和消失梯度 。 然而 , OMGD 的学生生成器仅利用教师网络的输出信息来进行优化 , 并且在无判别器的设定中进行训练 。 学生生成器不再与鉴别器紧密绑定 , 它可以更灵活地训练并获得进一步的压缩 。 具体来说 , 在每个迭代步骤中反向传播教师生成器和学生生成器之间的蒸馏损失 。 这样学生生成器可以模仿教师生成器的训练过程以逐步学习 。 其中蒸馏的损失函数由结构相似化损失函数和感知损失函数构成 。

推荐阅读

- bleu|字节跳动火山翻译上新 38 个稀有语种,翻译能力再升级

- Baidu|百度抢跑元宇宙 却默认“输给”字节?

- 模型|2022前展望大模型的未来,周志华、唐杰、杨红霞这些大咖怎么看?

- 字节跳动|抖音上线学习频道,为知识内容增加一级入口

- 模型|经逆向工程,Transformer「翻译」成数学框架 | 25位学者撰文

- 化纤|JXK STUDIO 虎年肥猫 1/6仿真动物模型手办可爱摆件

- 模型|达摩院2022十大科技趋势发布:人工智能将催生科研新范式

- 字节跳动|抖音正测试“通讯录”功能:神似朋友圈

- 模型|李彦宏:中国迎来AI黄金十年,集度汽车机器人明年亮相,智能交通10年内解决拥堵

- 模型|神经辐射场去掉「神经」,训练速度提升100多倍,3D效果质量不减