|为什么人脸识别系统总是认错黑人?

文章图片

图1/20

欢迎关注“创事记”的微信订阅号:sinachuangshiji

文/木子Yanni

来源:浅黑科技(ID:qianheikeji)

技术不懂什么是种族偏见 , 人脸识别却一再翻车 。

从良民到罪犯 , 有时候就是这么简单 。

(一)荒唐树上荒唐果 , 荒唐树下黑小伙

没有驾照 , 就不能开车抢劫?FBI 第一个站出来反驳 。

2019 年 1 月的一个周六 , 两名警察来到一家酒店 。 几十分钟前 , 他们接到报警 , 说有一名黑人男子在礼品店里偷吃零食 , 被店员逮了个正着 , 你们赶紧来看看呀 。

警察到时 , 被抓住的黑人男子已被带到酒店办公室 , 此人身高约 6 英尺 , 身穿黑色夹克 , 与肤色几乎融为一体 。

事不宜迟 , FBI 立马掏出小本本 , 盘问起事情经过 , 黑人男子非常配合 , 一开口就是道歉 , 说会把吃掉的零食钱补上 , 还主动把自己的驾照递给了 FBI 。

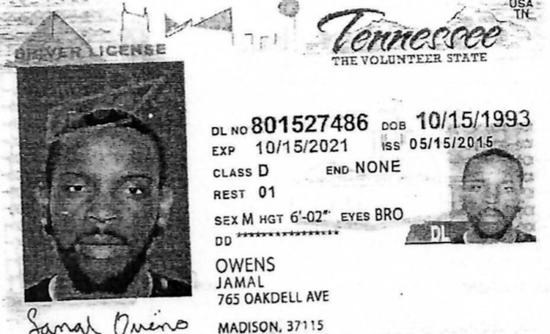

两名警察一看 , 诶 , 这小伙挺懂事儿 , 其中一名警察伸手接过驾照 , 瞥见姓名一栏印着 Jamal Owens , 另一名警察则开始搜身 。

文章图片

图2/20

男子交出的驾照

几乎是同一时间 , 两名警察都皱起眉头:一人察觉到驾照有异样 , 怀疑是个山寨货;另一人则在黑人男子的口袋里 , 摸到了一袋高度疑似大麻的东西 。

俩人警觉起来 , 顺势做出掏手铐的动作 , 就在此刻 , 刚刚还满口骚瑞的黑人男子 , 撒丫子就朝酒店门口狂奔 , 并迅速钻进一辆车里 , 疯了似的猛踩油门 , 哪怕撞上了停在不远处的警车 , 也只有三秒钟的减速 , 很快就消失在了街道尽头 。

尽管犯人在眼皮子底下溜走了 , 但往好处想 , 毕竟他的假驾照还在手里 , 顺藤摸瓜 , 绝对跑不了 。

两名警察迅速返回警局 , 把假驾照上的照片发给了拥有人脸识别技术的州政府机构 。

第二天 , 匹配就有了结果:照片比中了家住 30 英里外的一名黑人男子 。 资料显示 , 此人名叫帕克斯 , 在一家杂货店工作 。 (为产生误会 , 补充一句 , 帕克斯曾有前科 , 所以系统中留有照片)

谨慎起见 , 警员先把帕克斯的身份证和那本假驾照做了比对 , 认为是同一个人 , 又核对了一遍假驾照 , 确定照片上这个男子 , 就是当天逃跑的那个人 。

双重确认后 , FBI 立即签发了对帕克斯的逮捕令 , 罪名有盗窃商店、伪造政府文件、拒捕等 。

根据现有资料 , 警方突袭了几个可能的地址 , 却都没有找到帕克斯 , 反而是帕克斯本人在跟祖母聊天时 , 无意中听说警察在逮捕自己 , 坚信这是个误会的帕克斯 , 赶忙给表哥打了个电话 , 表哥一听 , 不敢耽误 , 迅速开车把帕克斯送到了警局 。

帕克斯本来是去澄清的 , 谁知警察不由分说 , 直接手铐伺候 , 还安排了好几个警察同时审讯 。

FBI:你自己干过什么 , 心里很清楚吧?

帕克斯:我冤枉 , 那人真不是我 , 我压根儿不会开车 , 今天还是我哥送我来的呢~

FBI:都到这儿了 , 你还装!我看你挺会开车~

帕克斯:嗯?我希望你搞清楚一点 , 不是所有的黑人都长得一样 。

FBI:还敢猖狂 , 来人 , 关起来 。

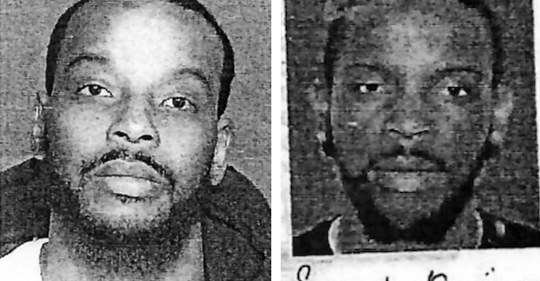

文章图片

图3/20

左:帕克斯 右:入店行窃嫌疑人

被关押了 10 天后 , 帕克斯终于获准保释 , 随后 , 他走上了长达一年的诉讼之路 。

说到被人脸识别误抓 , 帕克斯可不是唯一一个 。

2020 年初 , 威廉姆斯正坐在办公室里工作 , 突然 , 桌上的电话铃声大作 , 威廉姆斯接起电话 , 还没开口 , 对方先自报家门 , 称自己是底特律警察局 , 还说已经拿到威廉姆斯犯事儿的证据了 , 识相的话 , 赶紧去警局自首 。

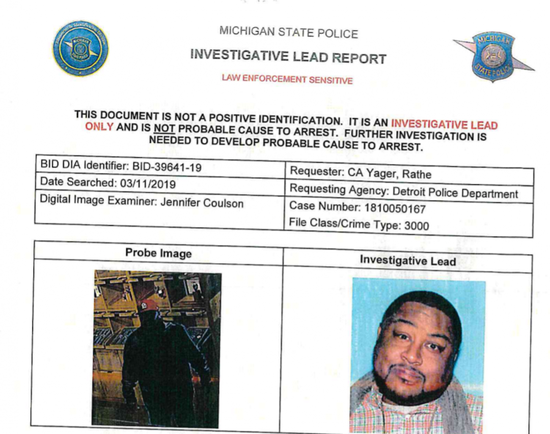

文章图片

图4/20

威廉姆斯本尊

骗子真多!威廉姆斯挂了电话 , 继续工作 。

一小时后 , 威廉姆斯刚把车开进自家车道 , 一辆警车就冒了出来 , 两名警察走下车 , 把一张纸举到威廉姆斯面前 , 上面印着一张照片 , 还有几个格外扎眼的词:“重罪逮捕令” , “盗窃罪” 。

随后 , 当着威廉姆斯妻子和两个女儿的面 , FBI 用手铐带走了他 。

文章图片

图5/20

威廉姆斯幸福的一家

在审讯室里 , FBI 举着三张照片 , 两张是被盗商店的监控照片 , 另一张是威廉姆斯的驾照照片 , 不厌其烦地引导威廉姆斯 , 希望他赶紧承认是自己盗窃了价值数千美元的钟表 。

和上个故事中的帕克斯一样 , 威廉姆斯也发出了同样的灵魂拷问:

警官 , 你是不是认为所有的黑人都长一个样?

文章图片

图6/20

左:被盗商店拍下的嫌疑人 右:威廉姆斯的驾照照片

拒不招认的威廉姆斯 , 在被拘留了 30 个小时后 , 终于等到了一句答复:

不好意思 , 我猜是电脑搞错了 。

与这两次误捕相比 , 奥利弗的遭遇更加心塞 。

奥利弗也是被人脸识别系统比中 , 被指控把手伸进一台车里 , 从一位老师手里抢走了手机 。

案发当时 , 这位老师看到学生在打群架 , 赶紧掏出手机录像 , 还没录多久 , 一个黑人男子就突然出现在车窗外 , 凶神恶煞地抢走了手机 。

文章图片

图7/20

左:手机录下的抢手机黑人男子 右:被捕的奥利弗

审讯室里 , 当 FBI 把照片摆成一排 , 准备开启讲道理模式时 , 奥利弗实在没忍住:我的胳膊上有陈年酿造的文身 , 你们再看看嫌疑人 , 胳膊上空空如也 , 我们怎么能是同一个人呢?

文章图片

图8/20

俩人的纹身区别

嘿 , 原来又是误会 。

荒唐树上荒唐果 , 荒唐树下 , 尽是美国黑小伙儿 。

(二)谁蒙蔽了人脸识别的眼睛?

人脸识别频频认错人 , 是技术的沦丧 , 还是“机”性的扭曲?欢迎收看本期真相揭露:人脸识别之深肤色尴尬了 。

2018 年 , 美国《纽约时报》发表过一篇文章 , 引用美国麻省理工学院的最新研究论文 , 证实在不同种族面前 , 人脸识别的准确率存在巨大差异 。

文章图片

图9/20

纽约时报刊文

研究员创建了一个包含 1270 张面孔的数据集 , 包括以深肤色为主的 3 个非洲国家 , 以及浅肤色的 3 个北欧国家 , 并找来三款主流的人脸识别系统进行测试 。

文章图片

图10/20

数据集中的一部分

结果显示:白人的识别错误率最低 , 仅为 1% , 肤色越暗 , 错误率越高 。 这其中 , 又以黑人女性的错误率最高 , 达到 35% 。

人脸识别难道成精了 , 深谙漂亮国那套歧视法则吗?又或者 , 背后有其他原因?

我们都知道 , 人脸识别技术依赖于深度学习 , 用来训练的数据集越大 , 样本类型越平均 , 效果也就越好 , 再配上一套优质算法 , 搭一个传感器 , 人脸识别就可以上岗就业了 。

在这个过程中 , 数据集、算法和传感器都是关键 , 那么 , 问题到底出在哪一环中呢?

1、缺失的数据集 。

早期 , 研究人员要想得到人脸照片 , 唯一的方式就是购买:贴出广告 , 吸引有意向的人来到实验室 , 在签署同意书后 , 让这些人在不同的光线下 , 用不同的姿势拍照 , 以此作为训练 AI 的样本 。

这种方式创建出的数据集 , 照片质量高 , 样本分布均衡 , 只有一个缺点:费钱 。

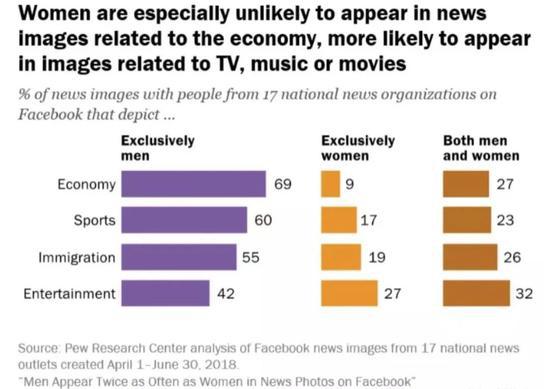

到了互联网时代 , 一种又快又不用花钱的照片获取方式出现了:网络搜索下载 。 铺天盖地的新闻图片 , 抓来就能训练 。

白嫖来的样本 , 自然比不上付费的 , 别的不说 , 光样本数据量分布就不达标 。

在美国 , 有超过 40% 的成年公民 , 主要通过 Facebook 来看新闻 , 有媒体对新闻配图按性别进行了统计 , 惊讶的发现 , 不管是经济还是娱乐版块 , 女性的出场率都远远低于男性 , 哪怕都是单人新闻图片 , 女性形象在图片中的占比 , 也处于劣势 。

文章图片

图11/20

女性出场率远低男性

但在现实中 , 美国的男女比例是大致均衡的 。

目前来看 , 单就网络上展示的性别比例 , 女性就已经输了 , 那肤色比例是否平均呢?

来自麻省理工学院媒体实验室的研究人员乔伊·博拉姆维尼 , 曾公开分享经历 , 说自己在很多场景下 , 只有戴一个白色面具 , 才能被人脸识别传感器看到 。

文章图片

图12/20

乔伊·博拉姆维尼

乔伊和同事们发现 , 人脸识别存在严重的性别偏见:最糟糕的情况下 , 深色女性面孔的失败率超过三分之一 , 相比之下 , 白人男性却有机会获得低至 0% 的错误率 。

为了寻找造成这种性能差异的原因 , 乔伊研究了两个常用的面部数据库 , 最终发现 , 这两个数据集中 , 浅色皮肤占据绝大多数 , 导致样本数据的不平衡 , 并最终导致了识别错误率的差别 。

为了抵抗数据集中存在的歧视 , 她发起了一个叫做“性别阴影” (Gender Shades) 的项目 , 重点强调交叉性:数据集应该兼顾四个类型 , 包括深肤色男 / 女性 , 以及浅肤色男 / 女性 。

文章图片

图13/20

“性别阴影”项目

2、一再失误的算法 。

2015 年 , 美国发生了一件“震惊三连”的事情 。

黑人小哥 Jacky Alciné 闲来无事 , 把一些照片上传到了谷歌相册 , 没想到 , Google 的图像识别算法在对照片进行分类的时候 , 竟然把他的黑人朋友认成了大猩猩 。

文章图片

图14/20

当事人气到爆粗口

震惊之余 , Jacky Alciné 第一时间向 Google 投诉 , 而 Google 听说这一事件后 , 同样表现的很震惊 , 马上向 Jacky Alciné 道歉 , 并承诺立刻整改 。

魔幻并没有停在这里 。

两年半之后 , 《连线》杂志震惊的发现 , 谷歌整改的方式竟然是:在图像识别算法中 , 删掉了“大猩猩 gorilla”这一类别 。 这意味着 , 不会再有黑人被识别成大猩猩 , 因为算法已经彻底不认识大猩猩了 。

这件事爆出后 , Google 承认 , 在图片识别标签中 , 他们确实删掉了“大猩猩” , 给出的解释是:“图片标签技术仍处于早期 , 很不幸 , 它离完美还差得远 。 ”

这、说什么好呢?我猜谷歌的人脸识别算法人员 , 应该都是白色程序猿 , 他们不会经历这样的事情 , 也没想到会有这样的事情 , 他们也很懵圈 。

现实中 , 深肤色人的面部特性确实比较难找 , 尤其在暗光环境下 , 光是检测到脸就很难了 , 更别提捕捉面部特征 , 这对于算法确实是一大挑战 。

在样本数据不足的情况下 , 人脸识别算法一般的做法 , 是根据特定的面部特征 , 比如眼距、肤色等 , 开启预测模式 , 但算法预测所依赖的面部特征 , 本身就不准确 , 势必会导致识别失误 , 比如把深色皮肤的女性识别成男性 , 或者把良民识别成罪犯 。

对算法来说 , 深肤色面部检测虽然是挑战 , 但也不是不能优化 , 关键在于是否利益相关 。

以上虽为个人猜测 , 但是 , 我也找到了一点论据支撑 。

很多互联网公司都有招聘算法 , 以亚马逊为例:如果一个男性是能力匹配的基准线 , 那么 , 女性申请者和她们的属性就会对应降级 , 再加上众所周知的历史传统 , 在实际操作中 , 肤色同样是职位考量的因素之一 。

这不禁让我想到小说《心是孤独的猎手》中的一句话:对黑人来说 , 所有白人长得都差不多 , 但黑人会费心辨认他们 。 另一方面 , 对白人来说 , 所有黑人长得都差不多 , 但白人通常不会费心记住一张黑人的脸 。

职位人选的底色 , 不仅会影响到某个算法的开发和执行 , 还会深刻影响整个领域的多样性 , 具象到现实 , 一定会出现深肤色人群被误认成大猩猩这样的闹剧 , 以及忽略算法优化、只是删掉大猩猩分类的神操作 。

3、选择性失明的传感器 。

如果说眼睛是心灵的窗户 , 那有些传感器的心是真的不灵 。

2009 年 , 德克萨斯州 , 在一家露营商店工作的两位工人 , 正在电脑上测试惠普新出的面部自动跟踪系统 , 并用视频记录下了整个过程 。

文章图片

图15/20

测试视频

在视频中 , 他们自称黑人德西和白人旺达 。

黑人德西说:“看看我进入画面时会发生什么 。 ”尴尬的是 , 什么都没有发生 , 摄像头完全追踪不到德西的脸 。

但是 , 当白人旺达的脸出现在摄像头面前时 , 面部追踪系统就开始工作了 。

此外 , 一位用户名叫做 Teej Meister 的油管用户 , 也曾吐槽一个感应洗手池:“白人专用?”

文章图片

图16/20

Teej Meister: “白人专用?”

你瞧 , 在人脸识别的传感器环节 , 社会责任感同样处于缺失状态 。

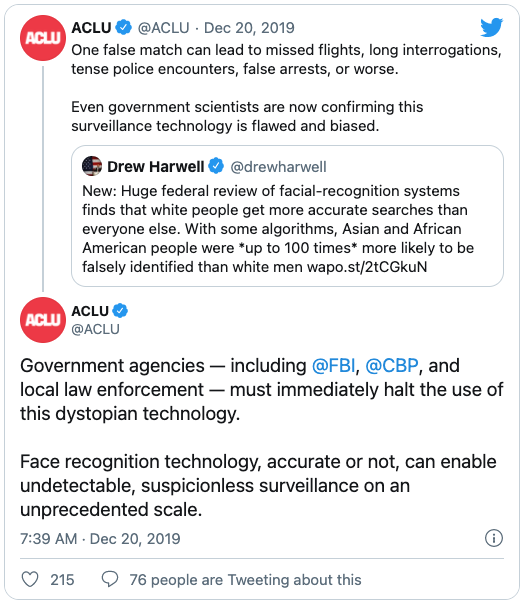

面对充满缺陷和偏见的人脸识别系统 , 很多国家的研究机构都在呼吁:“必须立即停止使用这项反乌托邦技术” 。

文章图片

图17/20

呼吁停止使用人脸识别技术

【|为什么人脸识别系统总是认错黑人?】如潮的舆论下 , 旧金山跑的最快 , 成为美国第一个禁止所有警察和城市机构使用面部识别技术的城市 , 它后面跟着一系列准备效仿、以及还在观望的城市 。

(三) 被误抓的黑人小哥 , 竟击中社会 G 点?

20 世纪 40 年代 , 乔治·奥威尔创作了一部反乌托邦小说《1984》 , 勾勒了一副令人窒息、压抑的画面:

未来的一大景象 , 是公民处于无处不在的严密监视下 , 为了躲避“老大哥”的监视 , 公民不得不秘密找到一个黑暗房间 , 通过在对方手臂上敲击密码来互相交流 。

文章图片

图18/20

《1984》中的“老大哥”

如今 , “老大哥”已经成为滥用政府权力的代名词 , 人脸识别技术就是一个重要工具:你以为老大哥看着你?它只是看错了你 。

小说只是艺术创作 , 但历史的车轮滚滚向前 , 黑人却始终站在话语权的边缘 。

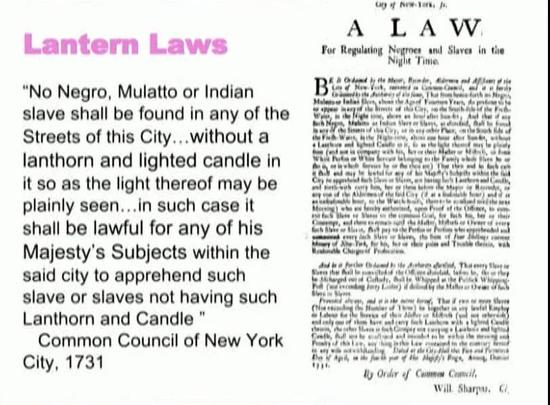

18 世纪 , 纽约曾施行一套法律:灯笼法 (LanternLaws) 。

文章图片

图19/20

LanternLaws

灯笼法规定 , 日落之后 , 黑人、混血儿和土著奴隶要想在城市里走动 , 如果身边没有白人 , 就必须携带一个蜡烛灯笼 。 如果不这样做 , 一经发现 , 就会被抓进监狱 , 直到“主人”来认领 , 而在等待期间 , 他们可能会经历殴打等各种遭遇 。

同一个城市的灯笼 , 并没有平等照亮每个人的权利 , 光是一种偏见 , 社会没有看见 。

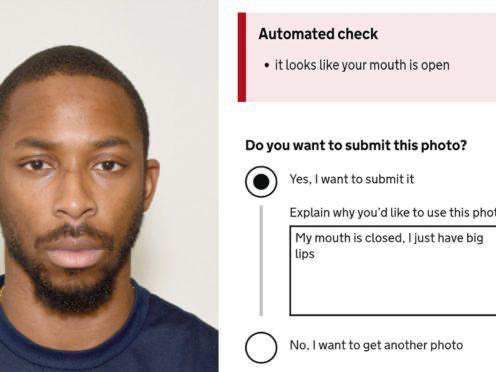

2019 年 , 28 岁的伦敦黑人男子巴达 , 正在通过网站更新护照 , 一个重要步骤是上传照片 。

巴达上传了一张提前准备好的高清照片 , 以为很快就可以完成更新流程 , 没想到 , 人脸识别系统竟弹出了一个令人哭笑不得的提示:不能上传张嘴照 。

网站对照片有严格规定 , 比如不能张嘴 , 不能闭眼 , 不能做鬼脸等 , 这些巴达早就知道 , 只是没想到 , 人脸识别系统竟“严格”到如此不讲道理的地步 。

重试 N 多次 , 系统始终提示照片张嘴无效 , 无奈之下 , 巴达只能在备注中写道:“我的嘴是闭着的 , 我只是嘴唇很厚 。 ”

文章图片

图20/20

张嘴?无效?

同一个国家的业务平台 , 并没有公平对待每个人的权利 , 算法是一种偏见 , 社会没有看见 。

直到几位黑人小哥被警局误抓 , 才终于击中了社会 G 点 , 这种来源于种族歧视和隐私信息滥用的双重愤怒 , 让社会不得不看见 。

蹲在警局里的黑人小哥挥挥翅膀 , 改变了不少风向 。

多地政府呼吁停止警局使用人脸识别技术 , 并发布了反面部识别条例;不少硬件厂商也开始有所动作 , 警用执法记录仪制造商 Axon 发声称 , 自家制造的摄像头产品将不具备面部识别功能;各大技术公司也开始变得谨慎 , 比如微软悄悄删除了据说是全球最大的公开人脸识别数据库 MS Celeb , 蓝色巨人 IBM 更是高调宣布 , 不再提供任何人脸识别服务和人脸分析软件 , 完全退出这一市场 。

看似一切都在改变 , 不过有趣的是:狡兔还有三窟 , 偏见又怎会把自己封在条框里?只要人心里有它的位置 , 它便能永生 。

参考资料:

1、https://abc7news.com/criminal-facial-recognition-racial-bias-in-technology-man-falsely-arrested-nijeer-parks/9197215/

2、https://abcnews.go.com/Business/federal-study-finds-racial-bias-facial-recognition-tech/story?id=67853261

3、https://www.nytimes.com/2020/06/24/technology/facial-recognition-arrest.html

4、https://www.freep.com/story/news/local/michigan/detroit/2020/07/10/facial-recognition-detroit-michael-oliver-robert-williams/5392166002/

5、https://www.nytimes.com/2018/02/09/technology/facial-recognition-race-artificial-intelligence.html?auth=login-google

6、http://proceedings.mlr.press/v81/buolamwini18a/buolamwini18a.pdf

7、https://www.media.mit.edu/projects/gender-shades/overview/

(声明:本文仅代表作者观点 , 不代表新浪网立场 。 )

推荐阅读

- 识别|沈阳地铁重大变化!能摘口罩吗?

- 识别|天津滨海机场RFID行李全流程跟踪系统完成建设 行李标签识别成功率可提升至99%

- IT|为什么感染飙升但死亡人数有限?研究显示T细胞可防止奥密克戎引发重症

- 德尔塔|为什么感染飙升但死亡人数有限?研究显示T细胞可防止奥密克戎引发重症

- 生活|2022,你为什么需要一块华为 WATCH GT3?

- 识别率|一群年轻人教“AI”学手语,目标是让千万聋人被“听见”

- 信息|财报识别系统教你怎样做好金融信贷审批工作!

- 数据|车牌识别相机在无人值守称重行业的应用

- 记忆|为什么现在的年度听歌报告,越来越好哭了?

- 人脸|“骁龙870版”小米12:小米12X发布:3199元起