机器之心报道

机器之心编辑部

算力技术的下一个浪潮 , 从未离我们这么近 。近年来 , 人工智能等技术的快速发展让计算机的算力需求暴增 , 但随着摩尔定律失效 , 传统芯片性能提升速度却开始大幅放缓 。 全世界都在寻找新的解决方法 , 光芯片的发展正让人看到希望 。

我们经常会看到光芯片技术、光学神经网络的研究登上 Nature 和 Science 等顶尖科学杂志 。 在一些研究中科学家们指出 , 光学开关的速度要比现在商用的顶级硅芯片的晶体管快 100 到 1000 倍 。

文章图片

相比如今顶级 CPU 每代性能约 20% 的提升水平 , 光芯片可能带来的提升非常夸张 , 这种技术距离实用化究竟有多远?科学家和创业者那里都有着不同的说法 , 从工作原理上看 , 它的确具有传统电子芯片所不具备的诸多能力 。

在我们熟悉的常规计算机上 , 芯片晶体管会通过在两种电状态之间切换来将数据表示为 1 或 0 , 进而执行各种逻辑运算 , 为复杂的软件提供算力 。 而在光芯片(photonic chip)上 , 我们可以将数字或模拟信号编码在光的相位或强度上 , 光在芯片中传播的同时完成计算 , 运算速度比普通计算机要快很多 。

光芯片对工艺尺寸要求也不苛刻 , 目前研究者们采用的主流工艺是 40nm, 甚至更早的工艺 , 而且稳定性良好 , 信息传输不受温度、磁场等常见环境因素影响 。

从「一个错误方向」到 AI 技术的希望

使用光进行计算的想法可以追溯到 1950 年代 。 但随着技术的发展 , 电子计算机成为了商业化铺开的选择 。 1980 年代 , 贝尔实验室曾尝试制造通用化的光芯片 , 但由于构建可工作的光学晶体管过于困难而失败 。

最近几年 , 人们又完成了一系列光芯片的研究 , 终于实现了技术突破 。

2006 年 , 英特尔推出首款标准 CMOS 工艺的电子混合硅激光器 , 基于此技术的超高带宽光学传输架构成为了高性能数据中心的研究方向 , 人们希望通过光传输降低数据中心的带宽瓶颈 。

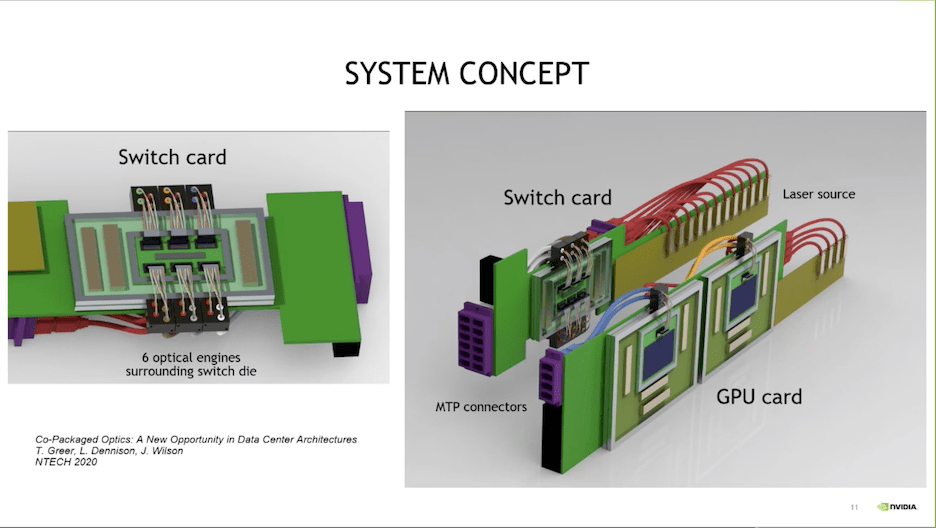

文章图片

在英伟达 GTC 2021 大会上 , 计算机架构专家 Bill Dally 设想了未来的光学 DGX , 其中 GPU 通过有机封装与电子集成电路进行通信 , 解决了芯片间的互联带宽问题 。

更加接近实用化的光计算芯片则在近两年被人们提出 。 2017 年 6 月 , 麻省理工学院的一个研究小组尝试将「光子计算」与「人工智能」结合 , 研究发表在自然 · 光子学子刊的封面文章《Deep learning with coherent nanophotonic circuits》上 。

推荐阅读

- 手表|采用美信光学传感器,豪鹏科技电池,GARMIN佳明VENU2手表拆解报告

- 系统验证|以技术革新加速芯片创新效率,EDA软件集成版PNDebug正式发布

- Apple|新专利显示 苹果计划用光学传感器取代手表的数码表冠

- 团队|玉米和水稻基因组引导编辑效率提高3倍

- 编辑效率|玉米和水稻基因组引导编辑效率提高3倍

- 影像|官方公布 5 米光学 02 星融合影像图,卫星刚完成发射

- IT|《柳叶刀》公布康希诺生物重组新冠疫苗最终有效率:重症保护率96%

- 代理商|思必驰会议魔方M1加速落地政企,助推办公效率开启新速度

- 硬件|空调热效率更高还要买电暖器?需求远比选择重要

- 质量|5米光学02星成功发射 自然资源质量生态监测再添利器