深度学习有一个万能逼近的能力 , 理论上任何一个映射 , 不管多复杂 , 深度学习理论上都有能力去近似它 。 如上面右图所示 , 一层感知机模型只能用超平面划分空间 , 两层神经网络已经可以表示凸多边形了 , 三层神经网络已经可以表达空洞或凹多边形了 。

加上大数据和算力的提升 , 深度学习一面世就在各个领域打败了传统机器学习算法 , 把数据驱动人工智能的算法统一为神经网络 , 也就是完成了算法的标准化 。 回想一下在深度学习之前 , 一位人工智能的研究生要学习多少种算法 , 支持向量机、决策树、隐马尔可夫模型、贝叶斯网络、马尔科夫随机场等等 , 每个算法背后都有自己的一套数学方法 , 每个领域都有自己的最有效算法 。 但是到今天 , 你会发现所有领域 , 基本上SOTA算法都是神经网络 , 而神经网络背后都是BP算法 。

所以神经网络和深度学习的厉害之处 , 在于标准化一统天下 。 标准化还在发生 , 甚至不同领域的神经网络结构也在趋同 。 大家如果关注趋势的话 , 会发现Transformer开始进入到计算机视觉了 , 自然语言处理领域也有人开始用卷积网络 , 神经网络结构越来越简化、统一 。

算法标准化最大的好处是 , 不需要为每个算法都写一套软件 , 只要一套软件(也就是深度学习框架)就能服务所有领域 。

深度学习的局限性深度学习本质上也是机器学习里的统计学习 , 所以也有机器学习的局限性 。

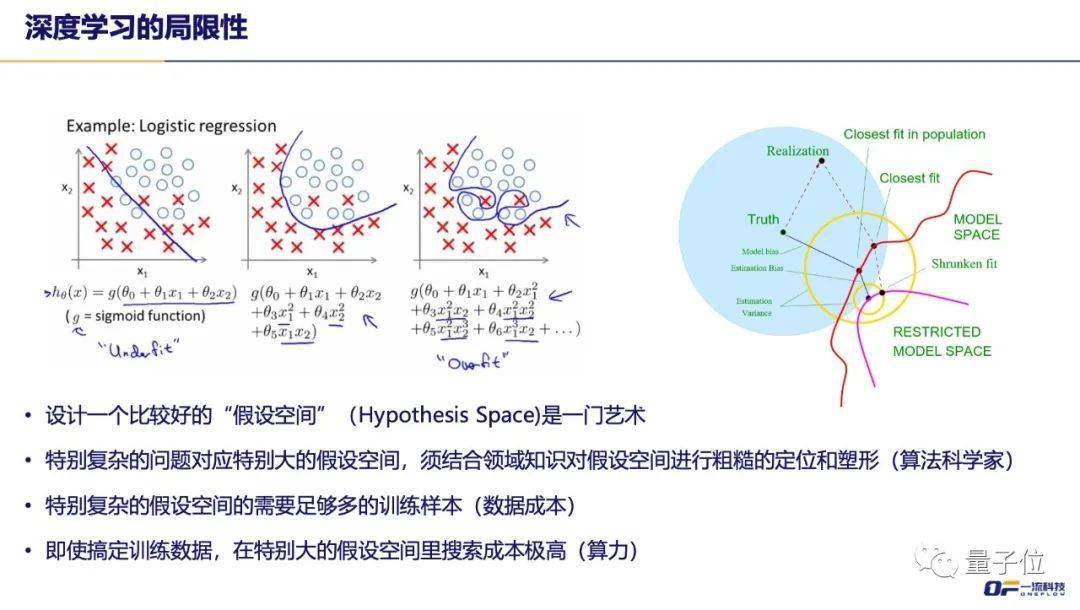

比如 , 既然深度学习是在一个假设空间(hypothesis space)里去找一个拟合数据质量还比较好的函数 , 就会出现一个问题:如果预先给定的假设空间里面不包含真实的解 , 那无论怎么求解都只能找到一个离真正的答案比较近似的解而已 , 而非最优解 。 特别是 , 当真实的解距离这个假设空间很远时 , 要找到这个近似解也会变得很难 。

【算法|一流科技CEO袁进辉:人工智能产业化困局和机遇 | 量子位·视点分享回顾】

文章图片

以左图为例 , 目标要分清楚圆圈和叉 , 我们一眼就可以看出最合适解的是一个二次曲线 。 假如说刚开始限定在线性模型里搜索 , 那无论如何都只能学出一条线 , 这就是假设空间太小 , 欠拟合 。 给它一个三次方程 , 理论上有可能学到这个二次方程 , 算法不一定能找得到 。 如果一步到位让算法在二次方程里去搜索 , 当然是最好了 。

熟悉机器学习的朋友知道 , 这是选取假设空间的问题 , 即算法科学家最核心的工作——给定一个问题 , 确定一个比较好的算法假设空间 , 使问题对机器学习来说是可行的 。 假设空间就像一块大石头 , 算法科学家就像雕刻家 , 不断的用刀去削它 , 把那些没用的石片都砍掉 , 当剩下的石头比较接近我们想雕刻的目标时 , 才把石头交给机器去加工和打磨 , 最终形成一个美妙的雕塑 。

推荐阅读

- 产品|泰晶科技与紫光展锐联合实验室揭牌

- 空间|(科技)科普:詹姆斯·韦布空间望远镜——探索宇宙历史的“深空巨镜”

- 相关|科思科技:无人机地面控制站相关设备产品开始逐步发力

- 机身重量|黑科技眼控对焦23年后回归,升级! 江一白解读EOS R3

- 公司|科思科技:正在加速推进智能无线电基带处理芯片的研发

- 项目|常德市二中2021青少年科技创新大赛再获佳绩

- 视点·观察|科技巨头纷纷发力元宇宙:这是否是所有人的未来?

- 技术|聚光科技旗下临床质谱仪获批医疗器械注册证

- 视点·观察|科技股连年上涨势头难以持续:或已透支未来涨幅

- 视点·观察|科技行业都在谈论“元宇宙”,可是它还不存在